2026 年央視春晚展示的機器人甚至可以夾烤腸和用竹籤串烤腸了,還有一臺登上本次春晚的機器人的價格甚至已經下探到萬元以下,距離進入尋常百姓家真的不遠了。可是,有一天真的來了一個機器人到你家裏幫忙,結果它卡在了沒法幫你回微信的第一步?

這聽起來像是一個笑話,但其實是目前機器人進家門遇到的真實問題。現在許多事情都離不開手機:智能門鎖需要授權密碼、刷個抖音都得用手指滑動解鎖。如果機器人不會操作手機,那麼當它幹完掃地擦窗的活兒,碰到這些需要依賴手機的任務就只能乾瞪眼。

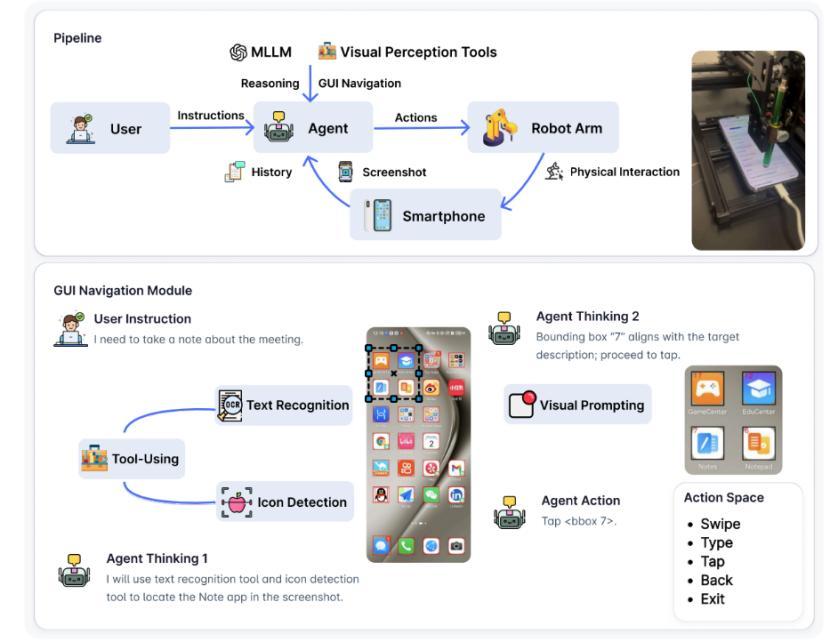

英國倫敦大學學院汪軍教授團隊趙皓宇博士生和合作者打造了一個名爲 See-Control(視控)的框架,讓機器人像人一樣看屏幕和思考,然後使用機械手指戳點屏幕操控手機,徹底繞開了過去智能手機助手必須給手機插數據線以及使用系統開發者工具才能操控的老路子。

圖 | 趙皓宇(來源:受訪者)

趙皓宇告訴 DeepTech:“我們解決了現在大部分廠家都存在的一個痛點:自動化手機助手操作手機必須要通過系統開發者工具配合數據線來與電腦連接,並且只能操控單一手機操作系統。想象一下你家裏有一臺機器人。也許是家務機器人,或者你桌上的機械臂。通過我們完全純視覺的方案,不依賴任何平臺開發軟件,可以擴展到任意的觸屏設備且不需要任何線接。同時用戶可以保證隱私不會有任何泄露,因爲手機完完全全是機械臂物理點擊交互,不需要開放任何權限、開發者協議,也不需要下載任何軟件。用戶完全不用擔心手機會不會泄露隱私。包括部分不會用智能手機的老人、不會用開發者選項在內的非專業用戶也可以通過這套系統來受益。”

(來源:https://arxiv.org/pdf/2512.08629)

通常,當我們希望使用電腦控制智能手機時,會使用一種叫做 ADB(Android Debug Bridge,安卓調試橋)的工具。它就像一根“數字電纜”,讓程序員可以直接向手機系統發送指令。

但問題就在這裏,使用 ADB 的方式與人類使用手機的方式並不一樣,我們不會把一根線插進大腦來打開應用,而是通過看屏幕、用手指輕觸來完成操作。另外,ADB 只支持 Android 平臺,還需要開啓特殊的開發者模式,這本身就可能帶來一定的安全風險,就像給系統留了一扇沒有上鎖的後門。

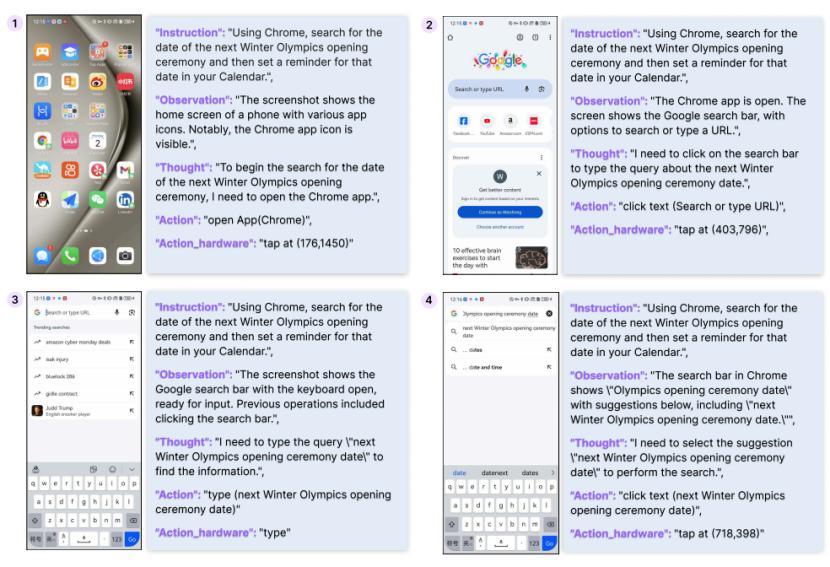

而基於物理交互方式的 See-Control 的工作原理特別像我們教老人使用智能手機:機器人盯着屏幕截圖,腦子裏的大模型分析這是微信紅包還是詐騙鏈接,然後決定到底是點一下、劃一下還是打幾個字。整個過程完全不碰手機核心部分,就像使用指尖操作一樣自然。

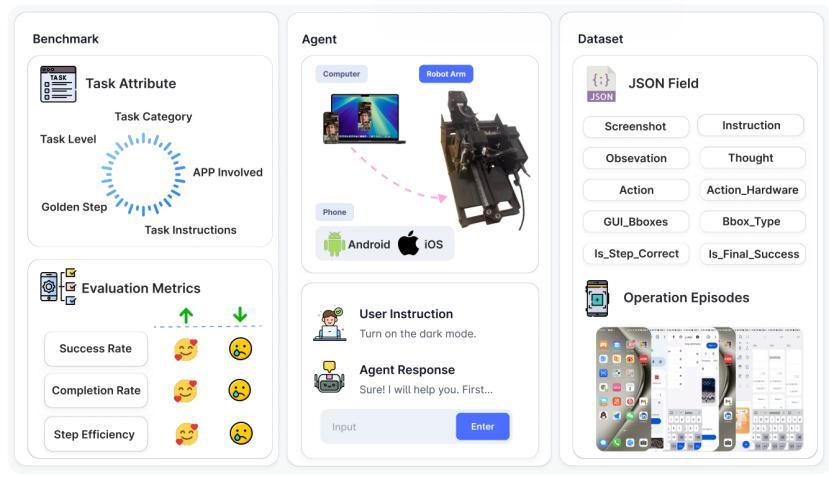

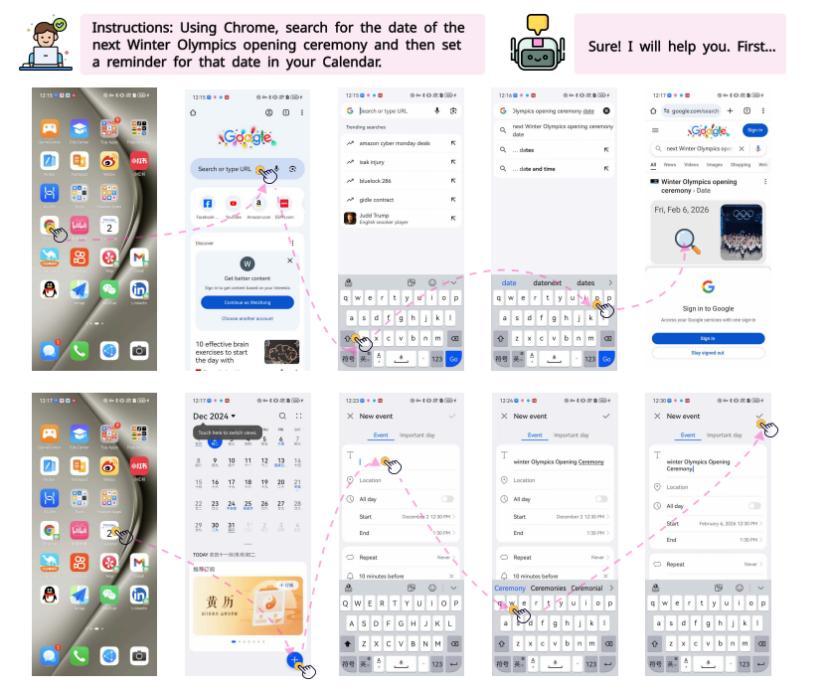

爲了讓它真正靠譜,該團隊專門設計了 155 個日常任務讓機器人練習,從最簡單的打開設置,到複雜的在小紅書搜索攻略、截圖、發給微信好友,難度步步升級。測試結果雖然不算完美,簡單任務的成功率還行(大於 90%),跨越多個 APP 的任務還有點手忙腳亂。但是,方向已經十分清晰,那就是未來的家用機器人可以通過觀察和觸摸來接管你的手機雜活。

該團隊將手機操作問題建模爲部分可觀測馬爾可夫決策過程(POMDP),並且將多模態大模型能力裝進了機器人裏,使用了 GPT-4o、QwenVL 這樣的視覺語言模型,讓機器人不僅能夠看見屏幕上的圖標和文字,還能理解點擊某個頭像背後的社交意圖。

有個特別有意思的設計是視覺提示:在智能體發出要對圖標進行定位的指令時,機器人先是用一個名爲 Grounding DINO 的目標檢測模型,把屏幕上可交互的按鈕全部框出來,標上數字 123,假如用戶要點披薩,這時機器人就會問大模型用戶讓點披薩應該點哪一個,大模型一看 3 號是某披薩品牌的圖標,OK 就它了。這套流程模仿了人類掃一眼屏幕、鎖定目標的本能反應。

(來源:https://arxiv.org/pdf/2512.08629)

當然,要讓機器人真的在你的手機屏幕上戳來戳去,還需要解決幾個頭疼的技術難題。最典型的是返回、退出和打字這三個動作。以前使用電腦上的系統開發者工具例如 Android Debug Bridge(ADB)調試手機,一條指令就能搞定;現在機器人只能使用物理手勢,想返回就得從左向右滑,想退回到桌面就得從底部向上推,特別是打字,還需要對虛擬鍵盤的每一個鍵的位置都有準確的認知。這也是目前複雜任務的成功率較低的原因。

但是該團隊留了一個後手。他們把機器人每次操作的思考過程和動作記錄全部保存下來,做成一個數據集公開分享。這裏既有成功的經驗,也有失敗的教訓,甚至標註了“這一步點對了嗎”“整個任務完成沒”等信息,讓其他研究者也可以依靠這些數據訓練出更聰明的機器人。

(來源:https://arxiv.org/pdf/2512.08629)

應用場景當然距離我們非常近。比如,未來你在沙發上喊一聲“幫我交話費”,機器人就會晃晃悠悠地走過來,看着手機屏幕點開支付寶和輸入密碼;再比如,當你出門忘記帶手機,遠程讓家裏的機器人幫你截圖快遞二維碼發到你的智能手錶上進行閃送;再再比如,家裏有老人不會使用打車軟件,機器人可以代勞叫車,送到醫院還能幫忙掛號。

趙皓宇表示:“我們做的用戶測試顯示,很多人都認爲這種形式能夠極大程度上幫助到老年人、殘障人士,或者一些沒有時間用手機的人,極大減緩工作時間,提高工作效率。想象一位重度運動障礙患者或年邁的老人:他們可能無法握持手機,或者因爲手抖而難以精準點擊細小的圖標。有了 See-Control,只需對語音助手說一句:‘給我孫子打微信電話。’機器人就會自動在手機屏幕上操作——打開應用、找到聯繫人、點擊呼叫按鈕,一氣呵成。它像一座橋樑,把數字世界與用戶的身體限制連接起來,讓原本困難甚至不可能完成的操作,變得簡單而可及。”

正常生活中我們可能要搶券、點外賣,這一切都會通過手機助手解決掉。通過賦能機器人使用手機,我們可以幻想不只是讓手機助手點外賣,機器人甚至可以完成點外賣到幫你直接將外賣拿到你的身邊的全流程。同時也有商業可能性,比如在小紅書自動尋找商機、回覆評論、找到相應帖子,這都能便利日常生活,極大減緩工作流程。“因爲我們這個解決方案是全部物理接觸,避開了應用本身存在的限制。”他說。

這種操作方式可以天然地保護隱私。過去用系統開發者工具,等於給機器人開了一扇後門,聯繫人、相冊、聊天記錄等一覽無餘。現在它只能看到屏幕,讓它點啥就點啥,絕不多看一眼。

當然,目前的原型機還比較簡單,只有一根手指,做不了放大和縮小這種雙指操作,反應速度也有所延遲。據瞭解,該團隊刻意使用最簡單的機械臂做測試,就是爲了先把最難的問題暴露出來,比如怎麼在反光的屏幕上精準定位,怎麼理解五花八門的 UI 設計,怎麼從錯誤中學習。這些問題一旦解決,未來搭配更靈活的機械手、更快的本地推理芯片,也許過不了幾年真的只需動動嘴就能讓機器人幹活了。

(來源:https://arxiv.org/pdf/2512.08629)

趙皓宇表示:“我們的願景是通過 See-Control 這套系統,實現一個統一的解決方案。這套方案不存在任何平臺限制,就是用一套純視覺的方案,通過手機屏幕畫面,讓機器人像模擬人類那樣去操縱手機。全部都是擬真的、物理的操作,不限於任何手機、任何平臺。在未來,我們也希望這套純視覺方案可以無縫銜接到不同的觸摸設備上面,通過機械臂完成一切需要像人類一樣交互的邏輯。”

在未來,其希望機器人不只是家中的掃地機器人,而是能夠作爲一箇中樞、一個全面的助手來幫助人類生活。可以想象,未來可能有殘障人士通過我們這套具身智能體來點外賣,機器人就可以去拿外賣、下訂單,完全實現自動交互。

參考資料:

相關論文

https://arxiv.org/pdf/2512.08629

趙皓宇主頁

https://haoyu-zhao.github.io/

排版:劉雅坤