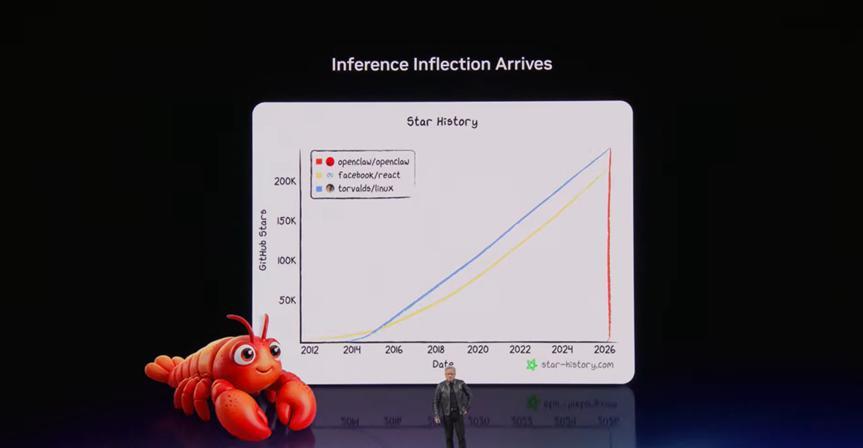

正在中國掀起的龍蝦熱,身在美國的英偉達 CEO 黃仁勳一直在關注。剛剛,黃仁勳站在 2026 年 GTC 大會的舞臺上,向全場觀衆展示了 OpenClaw 在中國的火爆。

(來源:英偉達)

“人們在深圳排隊買龍蝦,每個人都在談論 OpenClaw。”這個在中國深圳發生的真實場景,被他用來證明 OpenClaw 已經成爲人類歷史上最受歡迎的開源項目,它在幾周內就超過了 Linux 三十年的成就。

(來源:英偉達)

在這場兩個小時的主題演講中,黃仁勳發佈了英偉達版龍蝦 Nemo Claw 企業級 AI 智能體平臺、Rubin 平臺、Rubin Ultra、Feynman 架構、Vera CPU 以及多款開放模型,描繪了從芯片到軟件再到智能體的 AI 版圖。

(來源:英偉達)

與此同時,2026 年也是英偉達可編程着色器面世 25 週年,CUDA 面世 20 週年,黃仁勳也在演講中做了回顧,強調正是這些技術積累讓今天的 Rubin 平臺成爲可能。

英偉達版龍蝦 Nemo Claw:集成 OpenShell 安全層,不會泄露敏感信息

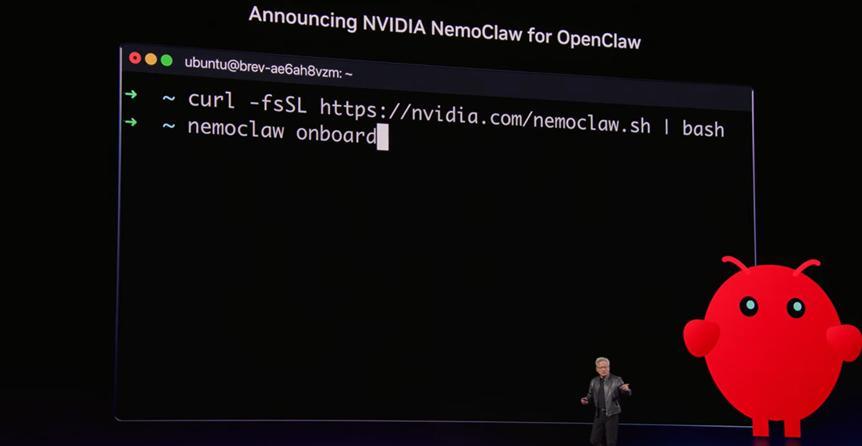

在發佈英偉達版龍蝦之前,黃仁勳用大量篇幅介紹了 OpenClaw。他展示了這個開源項目的驚人增長:你只需要在控制檯輸入一行命令,OpenClaw 就會自動下載、安裝、構建一個智能體,然後你可以告訴它任何需要完成的任務。

OpenClaw 本質上是一個智能體操作系統。黃仁勳說,這就像 Windows 讓個人計算機成爲可能,OpenClaw 讓個人智能體成爲可能。

(來源:英偉達)

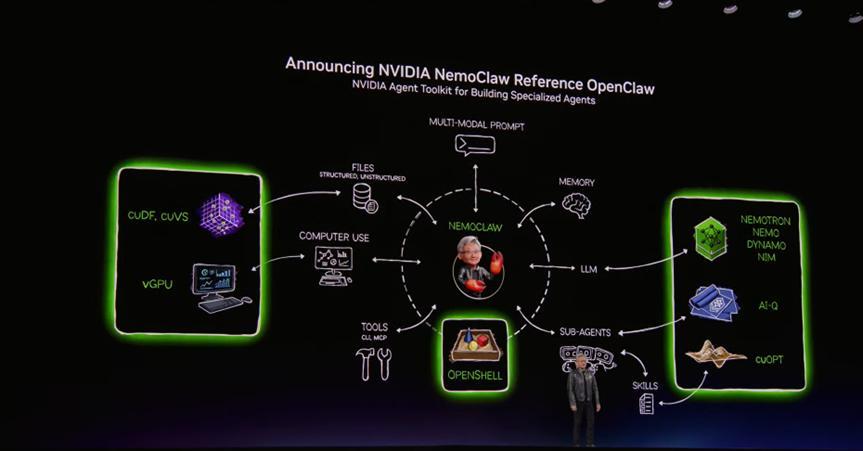

基於 OpenClaw,英偉達推出了企業級參考設計 Nemo Claw,黃仁勳特意說明 Nemo Claw 也是英偉達和“龍蝦之父”Peter Steinberg 合作的結晶。Nemo Claw 集成了 OpenShell 安全層,提供網絡護欄和隱私路由器,確保智能體在企業網絡中安全運行,不會泄露敏感信息。企業的策略引擎可以連接到 Nemo Claw,實現安全的智能體執行環境。黃仁勳宣佈,Black Forest Labs、Cursor、Mistral、Perplexity 等公司已加入 Nemo Tron 聯盟,共同推進智能體技術的發展。

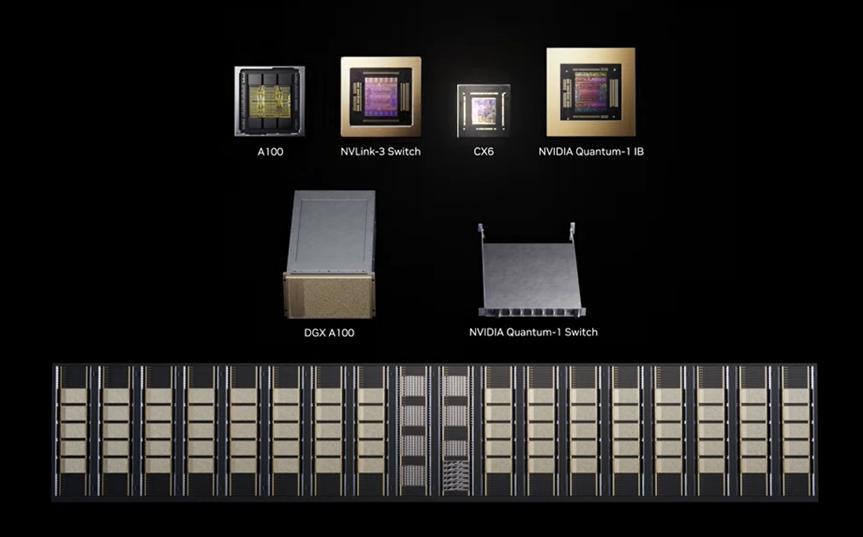

Rubin 平臺:英偉達下一代 AI 加速計算架構的核心

Rubin 平臺是英偉達下一代 AI 加速計算架構的核心。它由 Vera CPU、Rubin GPU 和 NVLink 72 交換系統組成。

(來源:英偉達)

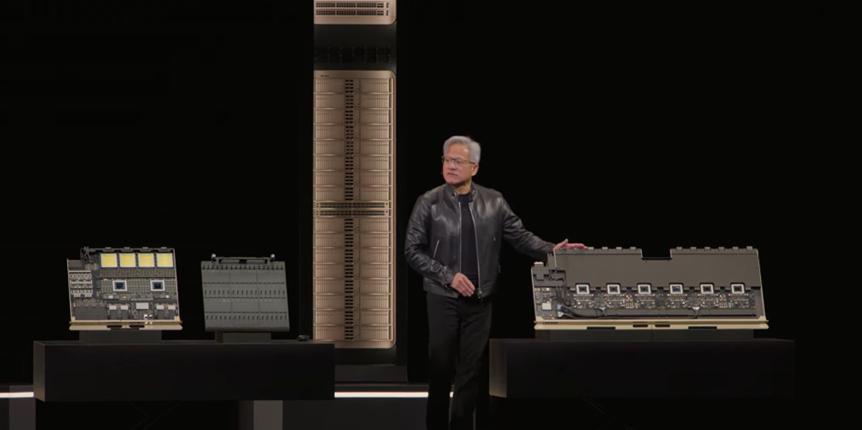

黃仁勳在現場展示了 Vera Rubin 系統實物,這個 100% 液冷的龐然大物,所有線纜都已消失,安裝時間從過去的兩天縮短到兩小時。

(來源:英偉達)

Vera CPU 是英偉達全新設計的數據中心 CPU,專爲智能體應用打造。它是世界上唯一使用 LPDDR5 的數據中心 CPU,黃仁勳表示它“擁有無與倫比的單線程性能和每瓦性能”。黃仁勳透露,Vera CPU 單獨銷售肯定會成爲一個數十億美元的業務。

他直言:“我們從沒想過會單獨賣 CPU,但現在我們在大量銷售。”據瞭解,Vera CPU 配合 BlueField-4 DPU 和 CX-9 SuperNIC,能夠爲智能體系統提供工具使用能力。智能體需要調用工具、訪問文件系統、執行代碼,這些都需要 CPU 的參與,而 Vera CPU 正是爲這個需求而生。

(來源:英偉達)

Rubin GPU 通過 NVLink 72 連接,實現 72 個 GPU 之間的 130TB/s 全互聯帶寬,整個系統作爲一個巨大的 GPU 運行。黃仁勳解釋說,智能體系統需要處理海量 token,需要頻繁訪問內存,需要快速使用工具,Rubin 平臺正是爲此而生。目前,第一臺 Vera Rubin 系統已經在 Microsoft Azure 上運行。

(來源:英偉達)

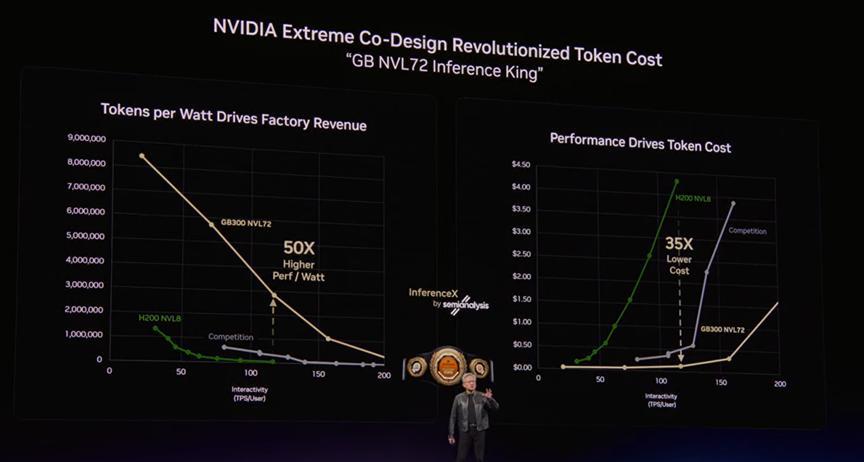

與 Hopper 相比,Rubin 在高端推理層級上實現了 10 倍的性能提升。黃仁勳用一張吞吐量與 token 速度的關係圖向會衆解釋,未來每個公司的數據中心都將成爲 token 工廠,而 Rubin 能讓每瓦電力產生最多的 token。在一座 1GW 的數據中心裏,Rubin 相比前代產品能帶來 5 倍的收入提升。

黃仁勳還宣佈,全球 100% 的存儲行業都正在加入英偉達的存儲加速生態,因爲未來的存儲系統將被 AI 而非人類頻繁訪問,需要 cuDF 和 cuVS 的加速支持。

Rubin Ultra:下一代高性能計算節點

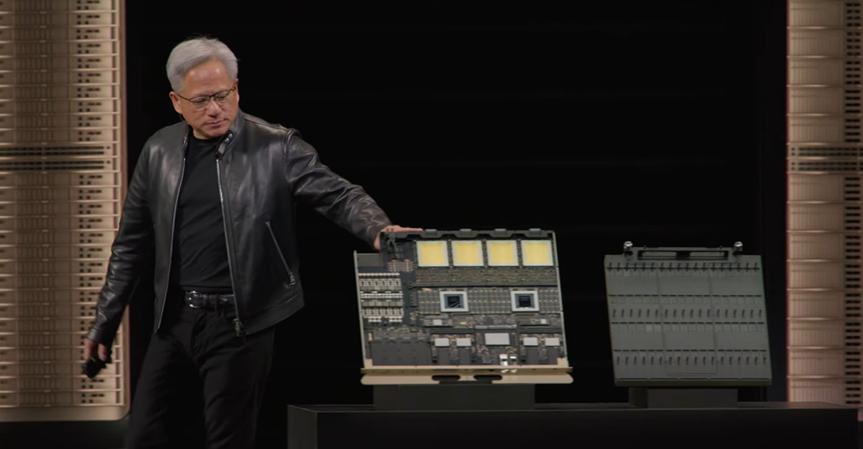

Rubin Ultra 是 Rubin 平臺的高性能版本,採用全新的 Kyber 機架設計。與 Rubin 水平插入不同的是,Rubin Ultra 採用垂直插入機架,每個 Kyber 機架能夠連接 144 個 GPU 形成一個 NVLink 域。黃仁勳現場展示了 Rubin Ultra 的實物,只見他雙手拎起也頗顯費力,並且這個重達數百公斤的大傢伙必須得小心搬動。

(來源:英偉達)

據瞭解,Rubin Ultra 芯片即將流片,配合 LPDDR35 內存,並將首次融入英偉達的 NVFP 計算結構,帶來數倍的性能加速。黃仁勳解釋說,Rubin Ultra 解決了高吞吐量和低延遲之間的矛盾。高吞吐量需要大量浮點運算,低延遲需要巨大帶寬。兩者本是敵人,但是通過極致協同設計,Rubin Ultra 在最需要高性能的推理層級實現了 35 倍的提升。而如果需要更高速度的 token 生成,還可以加入 Groq 芯片協同工作,將性能推向新的高度。

(來源:英偉達)

Feynman 架構:未來的下一代計算平臺

Feynman 是英偉達規劃的下一代計算平臺,以著名物理學家理查德·費曼命名。它將採用 LPDDR40 內存,聯合英偉達的 scale-up 技術和 Groq 團隊共同構建。Feynman 將配備全新的 Rosa CPU、BlueField-5 DPU 和 CX-10 SuperNIC,同時支持銅纜和共封裝光學器件的 scale-up。

(來源:英偉達)

黃仁勳強調,Feynman 將滿足未來對銅纜、光學器件和 CPO 的巨大容量需求。他說:“很多人問我,Jensen,銅纜還會重要嗎?答案是肯定的。(也有人問我)Jensen,你會做光學 scale-up 嗎?是的(我會)。”

另據悉,Feynman 也將是英偉達首個同時用銅纜和共封裝光學器件進行 scale-up 的平臺。從 Blackwell 到 Rubin 再到 Feynman,英偉達保持着兩年左右一代新架構的節奏。

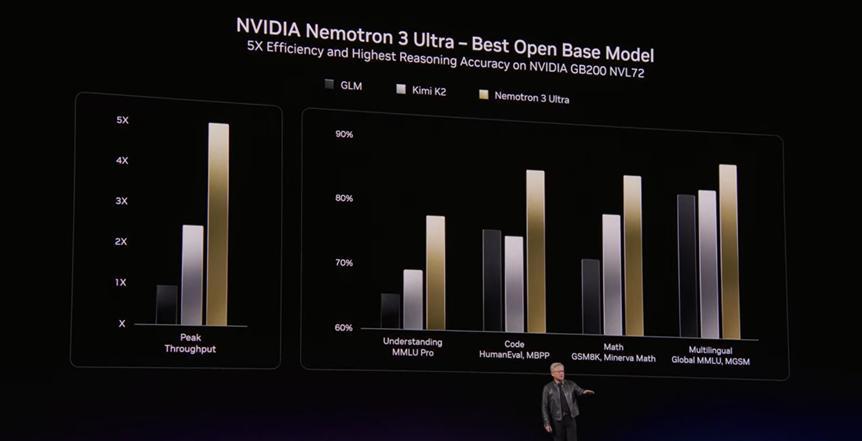

發佈多款開放模型,位居各自領域前列

黃仁勳還發布了六大系列開放前沿模型,全部位居各自領域的排行榜前列。他強調,開放模型是世界上最大、最多樣化的生態系統之一。

此次他發佈的六個模型分別是:

·Nemo Tron 推理模型用於語言和視覺理解,黃仁勳表示 Nemo Tron 3 Ultra 將成爲有史以來最好的基礎模型。

· Cosmos 用於物理世界生成和理解,能夠生成海量合成數據訓練機器人。

· Alpamayo 是首個會思考和推理的自動駕駛基礎模型,能讓車輛解釋自己的駕駛決策。

· GROOT 用於通用機器人,幫助人形機器人學習全身控制和操作。

· BioNemo 用於生物學和分子設計,加速藥物發現。

· FourCastNet 用於天氣預報和氣候預測,根植於物理學。

(來源:英偉達)

黃仁勳說,這些模型全部開源,開發者可以下載、微調和部署。後續,英偉達還將持續不斷地改進這些模型,以實現垂直整合和水平開放。在演講的尾聲,黃仁勳預測未來的工程師將需要年度 token 預算,就像今天的基本工資一樣。他認爲,將來每個公司都會給工程師發放相當於基本工資一半的 token,讓他們十倍地放大自己的能力。Token 將成爲硅谷的招聘工具,求職者會問這份工作附帶多少 token。最後,黃仁勳用一段機器人合唱的Rap結束了演講。Olaf 機器人也走上舞臺與黃仁勳互動,證明了自己在 Newton 物理引擎和 Omniverse 中學會了行走,實現了“迪士尼最萌打工人”和硬核技術的趣味聯動...