(來源:麻省理工科技評論)

如果你在關注 AI 新聞,你大概率已經看得眼花繚亂了——AI 堪比淘金熱;AI 只是經濟泡沫;AI 在搶走你的工作;AI 連個鐘錶都看不懂……

近期,在這些聲音中,斯坦福大學以人爲本人工智能研究所(HAI)撰寫的“AI 年度成績單” 新鮮出爐,以幫我們在噪音之中撥雲見霧。

儘管有預測說 AI 發展已經觸及到了天花板,這份報告顯示頂尖模型仍在持續變強。人們擁抱 AI 的速度,比當年接受個人電腦和互聯網時都要快。AI 公司創造收入的速度超過了以往任何一輪技術浪潮中的公司,與此同時它們也在數據中心和芯片上砸下數千億美元。而用來衡量 AI 的基準測試、用來約束 AI 的政策,以及整個就業市場,都在艱難地追趕 AI 的步伐。AI 在狂奔,而剩下的人還在找鞋穿。

這種速度是有代價的。全球 AI 數據中心的耗電量如今可達 29.6 吉瓦,足以在用電高峯時支撐整個紐約州的運轉。僅 OpenAI 的 GPT-4o 每年的耗水量,就可能超過 1200 萬人的飲用水需求。這些數據揭示了一項演進速度超過我們管理能力的技術。下面我們來看看這份報告裏幾個關鍵點。

中美水準並駕齊驅

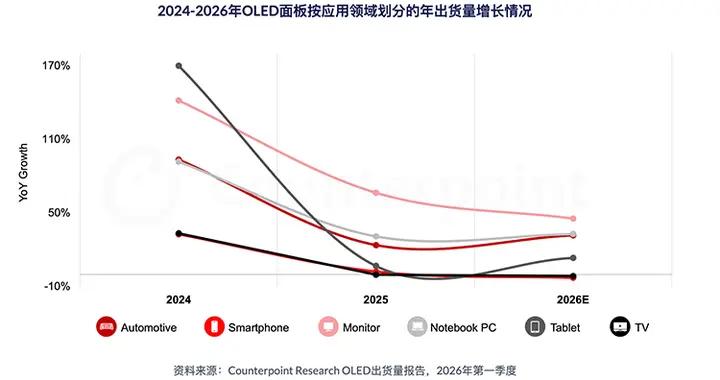

Arena 是一個由用戶驅動的 AI 模型排行榜,它讓用戶把相同的提示詞同時丟給不同的大語言模型,再根據大量用戶的投票結果給模型排名。根據 Arena 的最新數據,美國和中國在 AI 模型性能上幾乎並駕齊驅。2023 年初,OpenAI 憑藉 ChatGPT 遙遙領先,但隨着 Google 和 Anthropic 相繼推出自己的模型,這一差距在 2024 年逐漸縮小。2025 年 2 月,中國的 DeepSeek 推出的 R1 一度追平了當時美國最頂尖的模型 ChatGPT。截至 2026 年 3 月,Anthropic 位居榜首,緊隨其後的是 xAI、Google 和 OpenAI。DeepSeek 和阿里巴巴等中國模型也不遑多讓。如今頂尖 AI 模型之間的差距已經被壓縮到髮絲之細,它們正在轉而比拼成本、可靠性和實際可用性。

(來源:麻省理工科技評論)

報告指出,美國和中國的 AI 優勢各有不同。美國擁有更強的 AI 模型、更多的資本,以及估計約 5427 個數據中心,是任何其他國家的 10 倍以上;中國則在 AI 研究論文、專利和機器人領域領先。

隨着競爭加劇,OpenAI、Anthropic 和 Google 等公司已經不再公開模型的訓練代碼、參數數量和數據集規模。“關於如何預測模型的行爲,我們有很多東西還不清楚,”南加州大學計算機科學家、該報告的合著者約蘭達·吉爾(Yolanda Gil)說。她表示,這種不透明讓獨立研究人員很難研究如何讓 AI 模型變得更安全。

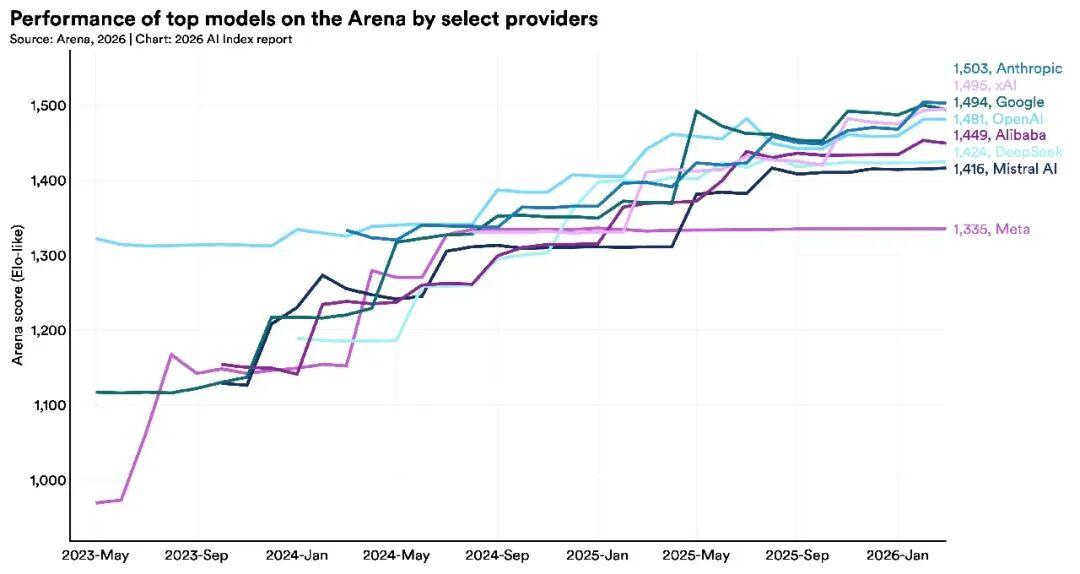

模型能力進步飛快

儘管有聲音預測發展會進入平臺期,AI 模型卻一直在變得越來越強。按某些衡量標準,它們在旨在測試博士級科學、數學和語言理解能力的考試上已經達到或超過了人類專家的水平。針對 AI 模型的軟件工程基準測試 SWE-bench Verified,頂尖成績從 2024 年的約 60% 躍升到 2025 年的近 100%。2025 年,一個 AI 系統獨立完成了天氣預報。

“這項技術持續在進步,完全沒有進入平臺期,我被震驚到了。”吉爾說。

(來源:麻省理工科技評論)

不過 AI 在其他很多領域仍然喫癟。由於模型是通過處理海量文本和圖像來學習,而不是通過親歷物理世界,它們表現出一種“參差不齊的智能”:機器人仍處於起步階段,只能完成 12% 的家務任務;自動駕駛汽車發展稍快,Waymo 已經在美國五個城市運行,百度的 Apollo Go 也在中國各地接送乘客。AI 也在向法律、金融等專業領域擴展,但目前還沒有哪個模型能主導這些領域。

基準測試已經落後

這些進步數據需要保留餘地。斯坦福報告指出,用來追蹤 AI 進展的基準測試正被模型飛速突破,已經跟不上節奏。有的基準本身就做得不夠嚴謹——一個流行的數學能力基準測試的錯誤率高達 42%。有的則容易被“作弊”:比如當模型直接在基準測試的數據上接受了訓練,它可以學會拿高分而並沒有真的變聰明。

由於 AI 實際使用的方式與它被測試的方式很少一致,基準測試的好成績並不總能轉化爲真實世界的表現。而對於 AI 智能體和機器人這類複雜的交互式技術,相應的基準測試幾乎還不存在。

AI 公司也越來越少公開自己的模型是如何訓練的,獨立測試得出的結論有時與公司自己報告的不一致。“很多公司不公開自己的模型在某些基準上的表現,尤其是那些涉及‘負責任 AI’的基準,”吉爾說,“你不公開某項基準的表現,這件事本身可能就說明了一些問題。”

AI 開始影響就業

進入主流視野不到三年,AI 的用戶已經覆蓋了全球超過一半的人口,普及速度超過了個人電腦和互聯網。估計有 88% 的機構組織在使用 AI,大學生裏每五人有四人用過 AI。

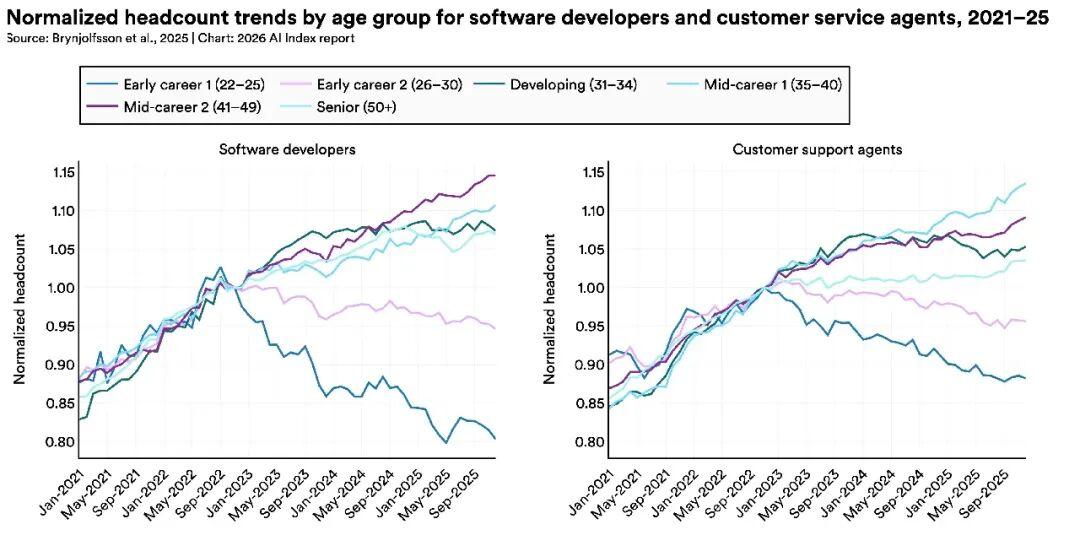

部署還處於早期,AI 對就業的影響很難量化。不過一些研究顯示,AI 已經開始影響特定行業的年輕從業者。斯坦福經濟學家 2025 年的一項研究顯示,22 到 25 歲軟件開發者的就業人數自 2022 年以來下降了近 20%。這一下降未必能全部歸因於 AI,更廣泛的宏觀經濟環境也可能是原因,但 AI 看起來確實在其中扮演了角色。

(來源:麻省理工科技評論)

僱主們表示招聘可能會繼續收緊。麥肯錫 2025 年的一項調查顯示,三分之一的組織預計 AI 將在未來一年內縮減他們的員工規模,尤其是服務與供應鏈運營和軟件工程領域。報告引用的研究數據顯示,AI 在客戶服務領域提升了 14% 的生產力,在軟件開發領域提升了 26%,但對那些更依賴判斷力的任務,生產力收益並未顯現。整體上看,AI 對經濟的更大影響還需要更多時間才能看清楚。

公衆專家判斷相左

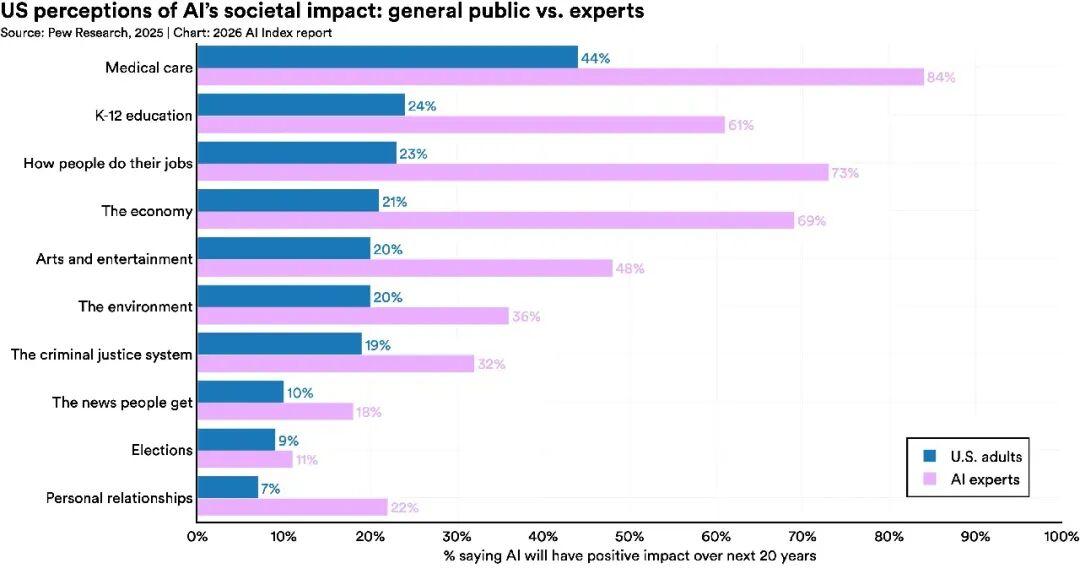

全球範圍來看,人們對 AI 既樂觀又焦慮:報告引用的益普索(Ipsos)調查顯示,59% 的人認爲 AI 帶來的好處會多於壞處,52% 的人則說 AI 讓他們緊張。

值得注意的是,專家和普通公衆對 AI 未來的判斷差異懸殊,最大的鴻溝出現在對就業的預期上:73% 的專家認爲 AI 將對人們的工作方式產生正面影響,但美國公衆裏持此觀點的只有 23%。在 AI 對教育和醫療的影響上,專家同樣比公衆更樂觀,但雙方都認同 AI 將損害選舉和人際關係。

(來源:麻省理工科技評論)

在受訪國家中,美國人對本國政府監管 AI 的信心最低——這是益普索另一項調查的結論。擔心聯邦 AI 監管力度不夠的美國人,多於擔心監管過度的人。

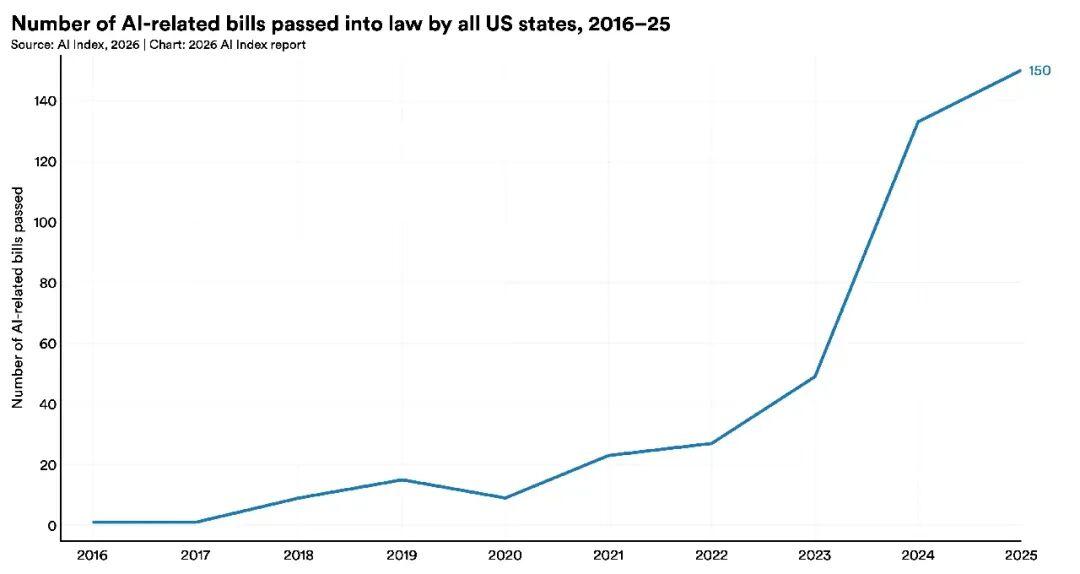

各國政府艱難立法

各國政府都在掙扎着爲 AI 立規矩,過去一年裏確實有一些進展。歐盟《人工智能法案》的首批禁令已生效,禁止在預測性警務和情感識別中使用 AI。日本、韓國和意大利也通過了各自的國家級 AI 法律。美國聯邦政府則走向了去監管化,特朗普總統簽署行政命令,試圖限制各州對 AI 的監管權。

儘管聯邦層面是這樣的動作,美國各州立法機構仍然通過了創紀錄的 150 項 AI 相關法案。加州通過了具有標誌性意義的立法,包括 SB 53 法案,要求 AI 模型開發者履行安全披露義務,併爲舉報者提供保護。紐約通過了 RAISE 法案,要求 AI 公司公開安全規範並報告重大安全事件。

(來源:麻省理工科技評論)

但吉爾說,儘管立法活動頻繁,監管仍然跑在技術後面,因爲我們對 AI 本身的理解還不夠。“各國政府在監管 AI 上很謹慎,因爲……我們很多事情都沒搞清楚,”她說,“我們對這些系統還沒有很好的把握。”

原文鏈接:

https://www.technologyreview.com/2026/04/13/1135675/want-to-understand-the-current-state-of-ai-check-out-these-charts/