2025 年 1 月,特朗普在白宮親自站臺,宣佈了一個號稱“史上最大 AI 基礎設施項目”的宏偉計劃。OpenAI 聯合軟銀、甲骨文和阿布扎比主權基金 MGX,組建了一家名爲 Stargate LLC 的合資公司,承諾在四年內向美國 AI 基礎設施投入 5,000 億美元。Sam Altman 負責運營,孫正義出任董事長,Larry Ellison 許下願景。那一天他們意氣風發,彷彿 AI 產業的新紀元就此開啓。

14 個月後,Stargate 的故事已經變得非常複雜。旗艦數據中心擴建談判崩了,得州園區因爲寒潮停擺好幾天,負責實體建設的關鍵高管已經走人,而 OpenAI 自己也不再執着於蓋房子,開始大規模租用別人的雲服務器。

2026 年 3 月 16 日,據媒體披露 OpenAI 已任命新的基礎設施領導團隊,把整個算力部門拆成了三個小組,由前英特爾高管 Sachin Katti 統管。Stargate 沒死,但它已經不是當初那個 Stargate 了。

阿比林(Abilene)是故事的起點。這座得州西部的小城拿到了 Stargate 第一個落地項目:一座由 Crusoe Energy Systems 開發的超大規模 AI 數據中心園區,佔地約 1,000 英畝,規劃八棟建築,總容量 1.2 吉瓦(GW,1 吉瓦大致相當於一座核反應堆的發電能力)。

圖丨Abilene 項目(來源:Crusoe)

園區前兩棟建築在 2025 年 9 月啓用,跑在甲骨文雲基礎設施(Oracle Cloud Infrastructure,OCI)上,爲 OpenAI 的訓練和推理任務提供算力。爲了把剩下六棟建築建起來,Crusoe 拿到了 116 億美元的債務和股權融資,其中摩根大通兩筆貸款加起來就有 96 億美元,可能是有史以來融資規模最大的單個數據中心項目。

第二期工程 2025 年 3 月開工,預計 2026 年年中完成。與此同時,甲骨文、Crusoe 和 OpenAI 開始談一件更大的事:把園區從 1.2 吉瓦擴到大約 2.0 吉瓦。額外的 800 兆瓦容量如果落地,阿比林將成爲全球最大的 AI 數據中心之一。

談判拖了大半年,最終沒談成。

Bloomberg 在 3 月 7 日的報道中提到了三個原因。融資條款談不攏,各方對資本分擔和經濟結構的預期差距太大。OpenAI 的需求預測一直在變,2025 年中期的方案到了 2026 年初已經面目全非,合作方很難據此做出投資決策。第三個原因更具體:阿比林園區出了運營事故。

2026 年初的一場冬季寒潮給阿比林園區造成了嚴重衝擊。園區採用的是閉環液冷系統,通過直接接觸芯片的管路帶走熱量,再由空氣冷卻器散熱,不消耗水資源。設計思路很好,問題是極端低溫來了之後,散熱迴路裏的管線凍住了。多棟建築因此停機數日,需要人工解凍後重啓整個系統。

這件事不只是“停了幾天電”這麼簡單。當下 AI 訓練集羣用的 Nvidia Blackwell GPU,單機架功耗可達 120 到 140 千瓦,單顆 GPU 功耗 700 到 1,200 瓦。熱密度大到只能靠液冷解決,而液冷系統的核心部件,冷卻分配單元(CDU),恰恰構成了單點故障。傳統數據中心幾十年來一直在消除單點故障,液冷的大規模引入又把這個老問題帶了回來。

據報道甲骨文和 Crusoe 的關係因設施的不穩定性變得緊張。兩家公司後來都發了聲明,說合作依然穩固、項目進展順利。聲明歸聲明,擴建沒談下去是既成事實。

擴建取消後出現了一個有點魔幻的連鎖反應。Nvidia 給 Crusoe 打了 1.5 億美元預付款,然後開始幫 Crusoe 把空出來的擴建容量推銷給 Meta。Nvidia 的目的不難理解:確保擴建區域裝的是自家 GPU,不讓 AMD 的芯片趁虛而入。芯片廠商在數據中心交易裏同時扮演金主、中間人和看門人,放在幾年前很難想象,2026 年倒已經不算什麼新鮮事。Meta 目前正在評估阿比林的擴建空間,談判還在進行中。

阿比林的擴建失利只是冰山一角。更大的變化在於,OpenAI 已經放棄了自己蓋數據中心的想法。

這個轉向有一條清晰的邏輯鏈。白宮發佈會之後,OpenAI 的人在全美各地跑,找能撐起 800 兆瓦到 1.2 吉瓦容量的選址,優先挑 2026、2027 年有大量電力接入的地方。真正的困難不在選址,在於 Stargate 合資公司本身出了問題。白宮發佈會之後的幾周裏,三方迅速陷入僵局。OpenAI、甲骨文和軟銀對各自的角色、項目的控制權和合作結構爭執不下,合資公司既沒有招人也沒有實際推進任何數據中心的建設。

據報道,Stargate 在宣佈後的初期處於羣龍無首的狀態,缺乏領導和協調。OpenAI 急需算力,一度打算甩開合作伙伴自己幹,直接租賃甚至擁有大型數據中心園區,減少對其他雲服務商的依賴。OpenAI 的高管在 2025 年 9 月到 10 月間多次飛赴東京跟孫正義談判,進展有限。

到頭來,這條自建路線也走不通:貸款機構不願意爲一家商業模式尚未驗證、每年燒掉數十億美元現金的公司擔保如此大規模的建設項目。面對這個財務現實,OpenAI 最終回頭找甲骨文和軟銀推進項目,但合作方式已經變了。

三方合資的框架基本名存實亡,取而代之的是 OpenAI 分別與甲骨文、軟銀簽訂的雙邊協議。OpenAI 不再追求自建和持有設施,而是通過租賃結構獲取算力,把建設和融資的資本負擔留給合作伙伴。

轉向的幅度相當大。OpenAI 跟 AWS 簽了七年 380 億美元的合約,跟甲骨文談了五年超過 3,000 億美元的基礎設施租賃協議(Stargate 框架下最大的單一合同),與微軟維持着約 2,500 億美元規模的長期合作(儘管 Azure 獨家供應商地位已在 2025 年終結),還跟 Google Cloud 建立了新關係。

芯片層面也在分散佈局:與 AMD 簽了多年期協議,可使用高達 6 吉瓦容量的 AMD Instinct GPU,對價可能包括 AMD 最多 10% 的普通股;與 Nvidia 達成意向書,部署至少 10 吉瓦的 Nvidia 系統,Nvidia 承諾逐步投入最多 1,000 億美元;同時還在用初創公司 Cerebras 的芯片。自研芯片方面,OpenAI 與博通(Broadcom)合作開發代號“Titan”的推理專用芯片,目標 2026 年下半年量產。

投資者材料顯示,OpenAI 預計到 2030 年的算力總支出約 6,650 億美元。此前媒體報道過更早的數字是 1.4 萬億美元,後來下調了。其中光是“備用”雲服務器的租賃,2026 到 2030 年間就要花約 1,000 億美元,加上常規雲服務支出大約 3,500 億美元,每年的雲服務賬單在 850 億美元上下。而 2025 年 OpenAI 的營收大約 130 億美元。公司預計 2030 年營收增長到 2000 億美元左右,但達到那一天之前累計虧損可能有 1,150 億美元。

OpenAI 的賭注是跟時間賽跑。它賭的是 AI 使用量的增長速度能跑贏它燒錢的速度,在資本市場的耐心用完之前把賬算平。

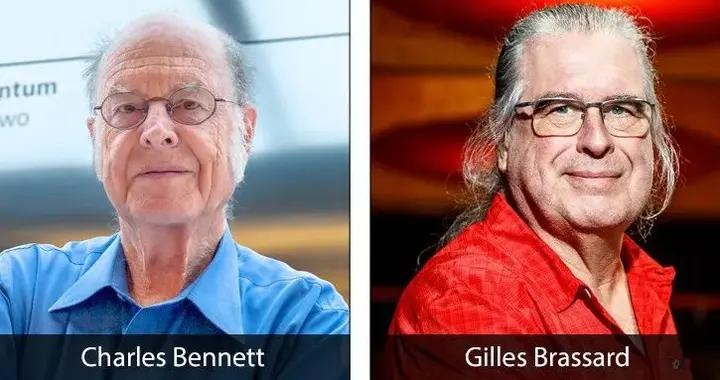

3 月中旬的基礎設施團隊重組就發生在這樣的背景下。據報道,Katti 把原來由總裁 Greg Brockman 直管、按項目劃分的算力團隊改成了按職能劃分的三個組。

圖丨 Sachin Katti(來源:Standford University)

第一個組負責數據中心的技術工程設計,評估不同芯片組合對設施需求的影響,決定集羣規模和選址。由前 Meta/Google 工程師 Chris Malone 和前微軟工程負責人 Adrian Caulfield 聯合領導。

第二個組負責商業合作關係管理,覆蓋與微軟、甲骨文、亞馬遜等雲服務商以及芯片廠商的合約。由老員工 Peter Hoeschele 領導,內部代號“Epic”(Ecosystems and Partnerships for Industrial Compute)。

第三個組負責數據中心實體運營,追蹤合作伙伴爲 OpenAI 建設的設施進度,確保服務器儘快上線。負責人是前 Google 數據中心總監 Nick Saddock。

Saddock 接手的位置,是幾周前剛離職的 Keith Heyde 留下的。Heyde 2025 年初從 Meta 加入 OpenAI,負責 Stargate 的實體建設。他在接受 DCD 採訪時形容過這份工作的日常:“太多東西每天都在變……我們依賴哪些合作伙伴、跟誰綁得更緊,一直在調整。”現在 Saddock 面對的問題跟 Heyde 時期已經不太一樣了。重心從“我們自己要建什麼”變成了“別人替我們建的東西什麼時候能用”。

Katti 在聲明中說,算力團隊已經構建了“跨雲、跨芯片、跨基礎設施的強大生態系統”。自研芯片團隊不歸他管,前 Google 芯片高管 Richard Ho 帶着大約 40 人的工程師團隊直接向 Brockman 彙報,與博通合作的項目獨立運行。兩條線並行:日常算力獲取歸 Katti,長線芯片研發歸 Ho。

“Stargate”這個詞的含義也隨之漂移了。當初它指的是 OpenAI、甲骨文和軟銀合建數據中心的具體項目。現在它更像是 OpenAI 整體算力戰略的品牌名。甲骨文的 OCI、亞馬遜的 AWS、微軟的 Azure、CoreWeave 的 GPU 雲,只要爲 OpenAI 跑任務的吉瓦級算力,都可以掛上 Stargate 的標籤。

OpenAI 官網上列出的 Stargate 站點已經分佈在得州、新墨西哥、威斯康星、俄亥俄和密歇根,總規劃容量超過 8 吉瓦,投資承諾超過 4,500 億美元。數字看着還是大得嚇人,實現路徑跟白宮發佈會上描繪的已經不是一回事。

回到一個基本問題:OpenAI 不自己建而是選擇租,這個策略說得通嗎?

從短期看,說得通。一家年營收百億級別的公司,同時承擔萬億級別的基建投資,無論怎麼算賬都不現實。把建設和融資的資本負擔甩給甲骨文、軟銀、Crusoe、CoreWeave 這些合作伙伴,自己控制設計和芯片選型,保留靈活性,是眼下最務實的做法。

麻煩在遠一點的地方。提供算力的那些雲服務商,微軟、亞馬遜、Google,自己都有 AI 產品,跟 OpenAI 既是供應商又是對手。Nvidia 通過投資、預付款和撮合交易,在整個生態裏積累了非常大的影響力,OpenAI 對此幾乎沒有制衡手段。

需求預測仍然高度不確定。ChatGPT 的周活躍用戶在 2026 年初達到了 9 億,推理模型之類的產品每次查詢消耗的算力遠超早期模型,訓練和推理之間怎麼分配資源也一直在變。阿比林擴建談判破裂的一個直接原因,就是 OpenAI 的需求預測變得太頻繁,合作方無法據此做長期投資決策。

Katti 在 Bloomberg 報道阿比林擴建取消之後,在社交媒體上回應說,阿比林園區“是美國最大的 AI 數據中心園區之一”,他們確實考慮過進一步擴建,“但最終選擇把額外容量放在其他地點”。不過話說回來,把算力分散到多個地點而不是押在單一園區上,確實比一年前的策略更能分散風險。只是 5,000 億美元和 10 吉瓦的承諾還在臺面上,Stargate 的每一步實際推進,都比白宮發佈會那天聽起來要難得多。

按照 OpenAI 自己的財務預測,公司預計 2030 年實現盈利,屆時年營收約 2,000 億美元,年度雲服務賬單約 850 億美元。在那之前,累計虧損可能達到 1,150 億美元。Katti 的三個新團隊眼下最緊迫的任務,大概不是畫下一張吉瓦級的規劃圖,而是確保已經簽下來的那些服務器合同能按時交付、跑起來不宕機。

參考資料:

1.https://www.theinformation.com/articles/inside-openais-scramble-get-computing-power-stargate-stalled?rc=p2bxcy

2.https://www.theinformation.com/articles/openai-names-new-infrastructure-leaders-following-stargate-strategy-shift?rc=p2bxcy

3.https://www.bloomberg.com/news/articles/2026-03-06/oracle-and-openai-end-plans-to-expand-flagship-data-center

運營/排版:何晨龍