1952 年,庫爾特·馮內古特(Kurt Vonnegut)寫了一本叫《自動鋼琴》(Player Piano)的小說。故事設定在一個工程師用自動化消滅了藍領工作的近未來,失業者被安排去做唯一剩下的事:維護那些取代了他們的機器。

七十多年後,這個設定幾乎成真,只不過被取代的不是流水線工人,而是律師、編劇、設計師和科學家,他們被安排做的也不是維護機器,而是一件更荒誕的事:教機器怎麼做自己的工作。

2025 年,據美國就業諮詢機構 Challenger, Gray & Christmas 統計,約 5.5 萬個崗位因 AI 被直接削減,全年僱主宣佈裁員總數達到 117 萬,是新冠疫情以來最高。

這些數字讓人焦慮,但更讓人不適的是這些數字背後還隱藏着一個“喫人”的鏈條:那些被 AI 擠出原有崗位的專業人士,正在成爲 AI 公司最主要的新勞動力來源,他們把自己花了十年二十年積累的職業判斷力,拆解成可供機器學習的結構化數據,以便 AI 更好地取代更多和他們一樣的人。

《紐約雜誌》和 The Verge 在 2026 年 3 月發表的一篇聯合報道,讓我們窺見了這個現象內部運作的一角。記者採訪了超過三十位白領數據工人,發現了一條荒誕的職業鏈條:

一個內容營銷人員因爲 ChatGPT 丟了工作之後,又被 AI 面試官錄用去訓練聊天機器人寫營銷文案;一個電視編劇發現自己的節目組用 ChatGPT 起草新劇集,轉頭接了一份給 AI 公司寫科幻劇本的數據合同;一個平面設計師眼看 85% 的客戶流失給了生成式 AI,最終吞下怨恨,註冊了數據標註平臺,給 AI 標註她曾經靠手藝賺錢的那類視覺素材。

這些人的共同處境是:他們在舊世界裏是受過訓練的專業人士,在新世界裏卻是按秒計酬的零工。

這些人之所以被需要,是因爲 AI 遇到了一個靠自己解決不了的問題。

大語言模型的能力來自於在海量文本上學習模式和規律,但公開互聯網上的數據正在被消耗殆盡,性能增長開始減速。2024 年前後,行業裏開始頻繁談論 Scaling Law“撞牆了”。早期的 RLHF(基於人類反饋的強化學習,Reinforcement Learning from Human Feedback)方法,訓練出的模型擅長讓回答聽上去像模像樣,但實際可靠性進步有限。

尤其像法律分析、廣告文案、管理諮詢、教育方案這些領域,不存在像編程一樣的天然驗證機制。什麼樣的投資建議算“好”?一封客服郵件的語氣怎樣才“恰當”?這些判斷本質上依賴人類的專業經驗。於是 AI 公司想出了一個辦法:既然沒有自動化的評判標準,那就花錢讓人類專家來“製造”標準。

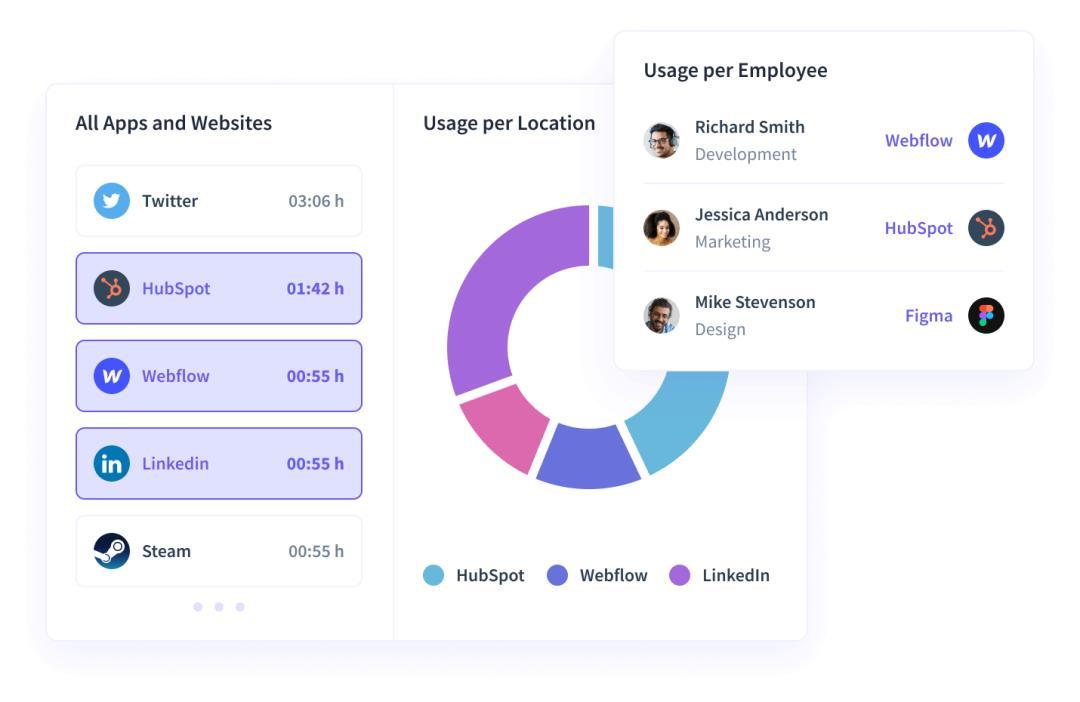

這就是所謂“強化學習經濟”(Reinforcement Learning Economy)的核心邏輯。一整套精密的數據生產流水線被搭建起來:有人負責編寫詳盡的評分量表(rubric),定義什麼叫好的 AI 回答;有人負責審覈這些量表是否合理;有人按照量表給模型的回答打分;有人撰寫“黃金答案”(golden output),作爲模型應該達到的理想示範;還有人用 AI 的口吻一步步寫出推理過程(reasoning trace),讓模型日後遇到類似問題時有跡可循。

更有一種叫“世界構建”(world-building)的項目形態,要求一羣律師或諮詢師角色扮演一個虛構企業的完整團隊,花幾天時間產出上百份會議記錄、財務模型和決策備忘錄,再把這些材料交給另一組人去拿它們考驗模型。

圍繞這條流水線,一批公司迅速膨脹。Mercor 是其中成長最快的一個。三個灣區的年輕人 2023 年創辦了它,起初做 AI 招聘匹配,後來轉向給 AI 實驗室供應專家級訓練數據。2025 年 10 月,C 輪融資 3.5 億美元,估值達到 100 億美元,三位 22 歲的創始人成爲全球最年輕的白手起家億萬富翁。同賽道上還有 Scale AI 和 Surge AI 等競爭者。

圖丨Mercor 創始團隊(來源:Mercor)

這些公司都在爭相網羅有學位、有經驗的專業人才,招聘廣告五花八門:廚師、管理顧問、野生動物保護科學家、私家偵探、記者、教師,甚至還有“北美青少年幽默專家”。一位行業資深人士在報道中評價說,這是人類歷史上規模最大的專業知識採集行動。

供給側也如這些公司所願異常紅火。面向應屆生的求職平臺 Handshake 在 2025 年 8 月的數據顯示,平臺上的崗位發佈量同比下降超過 16%,而每條招聘收到的申請多了 26%。高學歷者就業困難加劇的同時,Handshake 自己也推出了幫求職者對接 AI 訓練數據崗位的項目。“隨着 AI 重塑工作的未來,”該平臺在宣傳中寫道,“我們有責任幫助用戶參與 AI 經濟。”

參與 AI 經濟。聽上去很體面。但報道中呈現的實際體驗,和這個措辭之間有着巨大的落差。

幾乎所有受訪者都描述了同一種模式:項目初期待遇尚可,有人類主管可以溝通,工作甚至有些趣味。然後情況迅速惡化,任務量增加,完成時限縮短,薪酬下調。達不到新要求的人被靜默“下線”(offboarded)。有編劇談到,他認識的一些得過獎的導演和製片人不會公開說自己在幹這種活兒,但那就是他們目前養家餬口的方式。

有設計師描述了一個爲 Meta 做視頻標註的項目突然關閉後,數千人被邀請加入一個做同樣工作但時薪從 21 美元降到 16 美元的新項目,這個價格已經低於加州等多個州的最低工資。新項目的 Slack 羣裏刪掉了茶水間和互助頻道,連工人之間的私信功能都關掉了。沒有人知道該找誰問問題。

而這些人連工作時上廁所的自由都沒有。Mercor 要求工人安裝名爲 Insightful 的軟件,追蹤電腦操作精確到秒,無鍵盤輸入即彈窗質詢。被判定爲“非生產性”的時間可能被從報酬中扣除。

報道中一位做了多部流媒體劇集的編劇談到,所有構成“你是一個人”的瑣碎時刻,上廁所、給自己倒杯咖啡、因爲背痛而伸個懶腰……這些全都被剝奪了,因爲那不算工作時間。“工會最初就是爲了這些東西而成立的,”她說,“保障工時、午休、假期和病假。而現在這些全部倒退了。”

圖丨Insightful App(來源:Insightful)

而在 Surge AI 旗下的 Data Annotation Tech 平臺上,情況甚至更不透明。工人們經常連被解僱了都不知道,只是某天登錄後發現任務面板空了,客服按鈕也失靈了,這種現象被稱爲“死亡儀表盤”(dash of death)。

但我們也無法把這些問題歸咎於某一家公司,因爲根源在於整條供應鏈的運轉方式。

AI 實驗室發現模型在化學領域薄弱,就向數據供應商下單找化學家。化學家產出一批數據,供應商送去實驗室,項目暫停,等實驗室看效果。也許實驗室調整了數據需求,也許換了供應商,也許突然決定要的不是化學家而是生物學家了。

一位數據公司高管在報道中承認,AI 實驗室自己經常也不確定到底要什麼,而不確定性一路向下傳導,全部由最底層的工人承擔。爲了應對這種波動,數據公司刻意維持龐大的待命勞動力池。反正工人是獨立承包商,不需要醫保、帶薪假或失業保險,多招一個人的邊際成本幾乎爲零。

嚴格的保密協議又給工人加了一層枷鎖。他們不知道自己在給哪家公司幹活,合同裏只會寫“客戶”,也不被允許透露工作細節。他們無法積累可遷移的職業聲譽,無法用過往經歷去議價。

一位在數據行業工作超過十年的管理者對此有句話說得很直接:沉默本身就是僱主的定價權。只要工人不能證明自己做過什麼,他們就永遠沒有辦法要求與能力相稱的報酬。他們唯一的權力,就是繼續排隊。

排隊的人越來越多。一個項目結束後,工人們湧向 Mercor、Alignerr、Micro1、Handshake……這些平臺永遠在招人,用 AI 面試官篩選,招聘成本趨近於零。一個受訪者說她申請了幾十個項目,只拿到了三個。

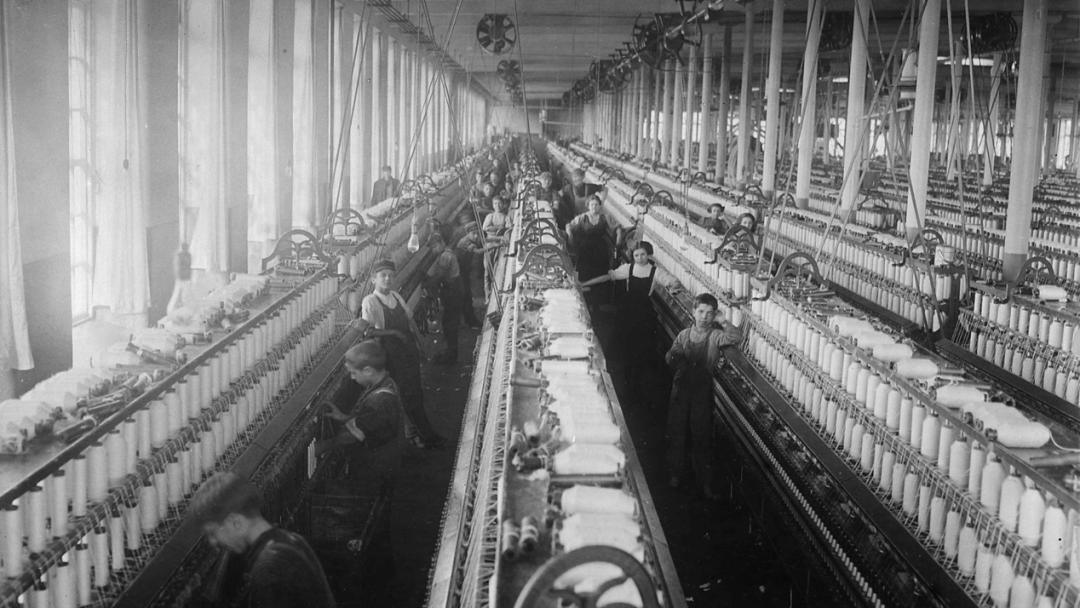

這裏面有一個工業革命以來反覆出現的結構性故事。

麻省理工學院經濟學家 Daron Acemoglu 用英國織工的遭遇做過類比:機械化之前,織工是自僱的手工業精英,掌控自己的時間和技藝。紡織機出現後,他們被迫進入工廠,接受更長工時、更低報酬和管理層的密切監視。技術不僅奪走了舊工作,還催生了一種將所有權力集中在資本一方的勞動組織方式,直到幾十年的工人運動和勞動立法才設了限。

(來源:HISTORY)

加州是目前美國唯一產生一些阻力的地方。過去半年,至少三起集體訴訟指控 Mercor 將工人錯誤歸類爲獨立承包商。Scale AI 和 Surge AI 此前也面臨類似訴訟,Scale AI 正在和解中。原告律師的核心論點是:鑑於公司對工人行使的“非同尋常的控制”,例如指定平臺、安裝監控、設定詳細操作流程等,將他們定義爲獨立承包商在法律上站不住腳。

2026 年 2 月,美國勞工部發布了一項新的擬議規則,試圖釐清僱員與獨立承包商的界定標準。但這些法律框架能否追得上這種全新勞動形態的擴張速度,仍然是個問號。

而且,正如報道中一位律師指出的,數據標註工人和 Uber 司機相比有一個更大的弱勢:Uber 司機必須在某個城市物理存在才能接單,可以本地化組織和維權;數據工人完全可以被遠程替換,如果美國工人爭取到了更高報酬,公司轉頭就能從其他國家找到更便宜的人。世界銀行估計全球有 1.5 億到 4.3 億數據勞動者,大量分佈在全球南方國家。

但即便這些勞動權益問題都得到了妥善解決,也無法改變一個更根本的事實:每一個具體的數據訓練項目,都在朝着自身消亡的方向推進。你教 AI 做法律分析,AI 學會了,你的法律分析數據就不再被需要。你幫 AI 掌握了語言學中的冷門分支,那個分支就從需求清單上劃掉了。

報道中有一位語言學碩士,做了一年的 rubric 工作。到 2025 年末,他發現,不管他問模型多冷門的理論和瀕危語言,模型都能找到正確的論文。他從每週提交三四個 rubric 變成勉強完成一個。項目結束後,他已經五個月沒有找到新工作。

Marketing AI Institute 的 Paul Roetzer 用一個場景來描述這種循環的終極形態:假設 AI 實驗室想自動化初級會計工作,它花高價僱一百名資深註冊會計師,以遠高於市場的時薪來微調一個模型,直到模型表現得和普通人一樣好,甚至超過專家。

“然後,那個崗位就被自動化了。”整個行業雖然仍在膨脹,但對每一個具體的人來說,自己擁有的那份技能被完整提取的那天,就是自己被“下線”的日子。

這就構成了當前 AI 勞動經濟中最殘忍的循環:系統需要你的專業知識,但需要你的專業知識,恰恰是爲了不再需要你。人花十年二十年練就的判斷力,在這個系統裏變成了一種一次性消耗品,被提取,被用來訓練模型,然後被丟棄。

我們當然可以認爲,AI 時代,一些人類獨有的特質會更有價值,例如品味、判斷力、創造力和同理心。Mercor 的 CEO Brendan Foody 自己也說過類似的話,“AI 自動化了 90% 的經濟之後,人類就成了剩下 10% 的瓶頸,每一單位人類產出的槓桿效應是以前的十倍。”這話在邏輯上沒有錯。

問題在於,它描述的是一個贏家通喫的世界:對頂尖的那一小撮人來說,他們的判斷力確實可能身價倍增;但對絕大多數普通專業人士來說,這種說法近乎苛責。不是每個律師都是最高法院的出庭大律師,不是每個設計師都有不可替代的美學直覺,不是每個編劇都能寫出讓 AI 望塵莫及的劇本。

大多數人的專業能力,恰恰處在“足夠好、但可以被標準化提取”的區間裏,好到可以被用來訓練 AI,卻又沒有好到 AI 學完之後仍然需要他們。數據標註行業的殘酷之處在於,它精確地利用了這個區間。

那些被招去寫 rubric 和 golden output 的人,是因爲他們夠專業才被選中的;但也恰恰是因爲他們的專業程度可以被拆解成規則和示範,他們的知識才具有被提取的價值。真正無法被拆解的那種頂級判斷力,它確實存在,但它從來不是多數人擁有的東西。

把“人類特質會更有價值”當作一種普遍的職業建議,多少有些社會達爾文主義的味道:它假設每個人都能成爲那個不可替代的人,而事實上,大部分人只是在做自己力所能及的、體面的、有尊嚴的工作。這些工作正在被系統性地拆解。

Anthropic 自己最近發佈的一項研究提供了一個有用的框架來理解這種處境。在題爲“AI 的勞動市場影響”的報告中,研究者發現 AI 的實際採用率遠低於其技術上的可行替代率。也就是說,AI 在很多領域已經有能力取代人類完成任務,只是尚未全面部署。

這之間的時間差,既是緩衝,也是倒計時。數據標註行業的故事展示的正是這段緩衝期裏發生的事:不是大規模的突然失業,而是大量受過良好教育的人發現,自己唯一能找到的工作就是參與訓練 AI,在極不穩定的條件下,用自己最值錢的東西換取臨時性的報酬,同時加速這份報酬最終歸零的進程。

關於政策應對,目前討論最多的是 AI 導致大規模失業後該怎麼辦,重新培訓、全民基本收入等等。但另一種可能同樣值得關注:也許不會出現驟然的大規模失業,而是越來越多的具體任務被 AI 接管,人類被重新分配到生產流程的其他環節,一部分人修改 AI 產出的半成品,另一部分人編寫 rubric 來改進它。

這類工作天然是間歇性的,意味着它將由獨立承包商來完成,而現行法規對這類工人幾乎沒有保護。Acemoglu 認爲,我們可能需要某種類似工會的集體組織,來防止大公司用分而治之的策略持續壓低數據價格。“如果沒有適合數據經濟的法律基礎設施,”他說,“許多生產數據的人將會被低薪僱用,或者用一個更重的詞,被剝削。”

最令人唏噓的,或許是那些已經走到這條路盡頭的人。Katya 在被邀請加入 16 美元時薪的 Nova 項目後,決定不幹了。她去應聘了一家咖啡店。“至少在咖啡店拿最低工資的時候,你還有幾個可以聊天的同事,有一個假裝在乎你的老闆。你知道下週你的班表是什麼樣的。”這不是她讀研究生時想象中的職業轉型,但她覺得做咖啡師至少比被算法監控着搶活兒幹更有尊嚴。

然後她的手機響了。一個之前暫停的項目又開始了。

這個結尾幾乎可以成爲我們這個時代的寓言:一個合格的、有經驗的、受過高等教育的人,在“訓練 AI 取代自己”和“去咖啡店打工”之間來回彈跳。這不是任何單一公司的惡意,Mercor 也好,Scale AI 也好,Surge AI 也好,它們只是供應鏈上的中間節點。

真正的問題在於,當前的技術發展方式和勞動制度安排,讓“人類專業知識”變成了一種一次性消耗品:被提取,被用來訓練模型,然後被丟棄。

如今 AI 行業喜歡談論“人在迴路中”(human in the loop)的對與錯,但從這些數據工人的經歷來看,在 AI 真正接管完整工作迴路、社會的生產分配方式發生重大變革之前,迴路裏的他們更像是一根正在燃燒的蠟燭,它的存在價值,就在於把自己燒完,然後“退出”。

問題是:燒完之後怎麼辦?到目前爲止,沒有人給出一個像樣的答案。

參考資料:

1.https://nymag.com/intelligencer/article/white-collar-workers-training-ai.html

運營/排版:何晨龍